AI共存社会が広がりを見せる中、専門家や国単位で問題視されているのが、電力量やデータ処理に関する問題です。急速に拡大を見せるAIの活用で、データ処理に必要な計算能力が爆発的に増えているのはご存じですか?

この記事では、AI活用の未来の社会的・物理的限界とその対策についてご紹介します。

AI活用拡大によるデータ処理の現実

EPOC AI

AIの進化予測などの研究分析を行っているアメリカのEPOC AIの研究において、2030年までに、最先端AIの学習(モデルを賢くするために回す計算の総量)が桁違いに増え、使われる計算量は国家レベルの計算資源が必要なほど莫大なものになるとの見解が出ています。

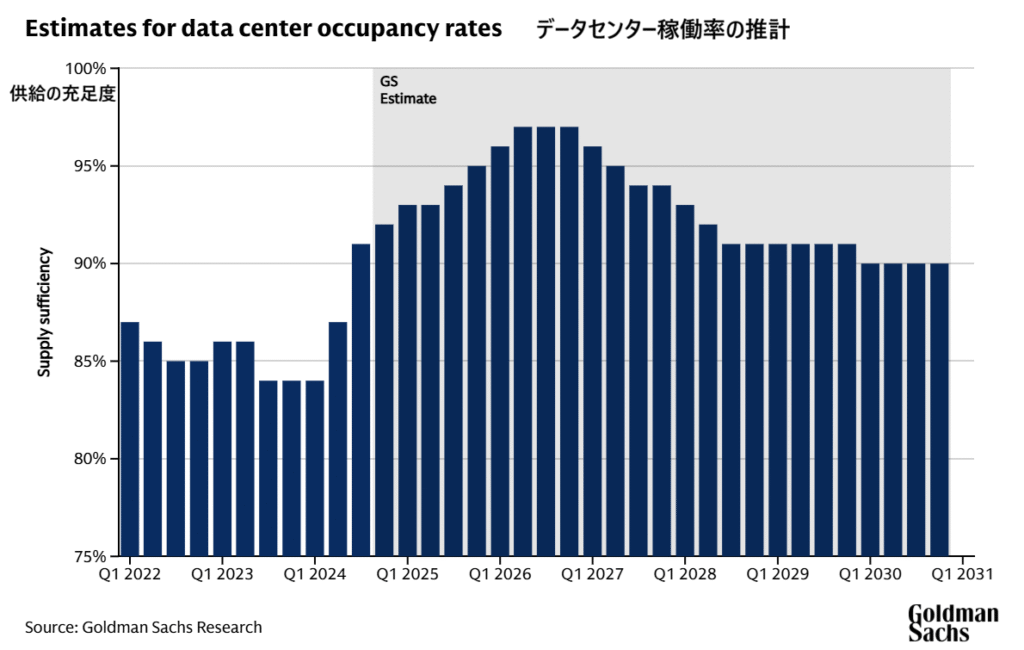

ゴールドマン・サックス・リサーチ

ゴールドマン・サックス・リサーチによるレポートにおいても、データセンターからの世界の電力需要が2027年までに50%増加し、10年後には(2023年と比較して)165%も増加するという予測が報告されています。

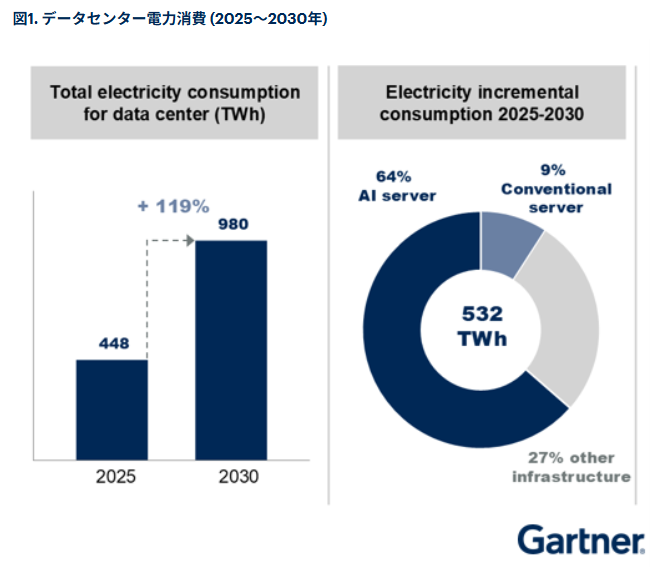

Gartner

米国のリサーチ&アドバイザリー企業であるGartnerは、世界のデータセンターの電力需要は2025年に16%増加し、2030年までに2倍になるとの見通しを発表。Gartnerのアナリストは、世界のデータセンターの電力消費量が2025年の448テラワット時(TWh) から2030年には980TWhに増加すると予測しているとしています。また、データセンターの追加電力需要の64%をAI最適化サーバーが占めることになるとしており、その緊急性を訴えています。

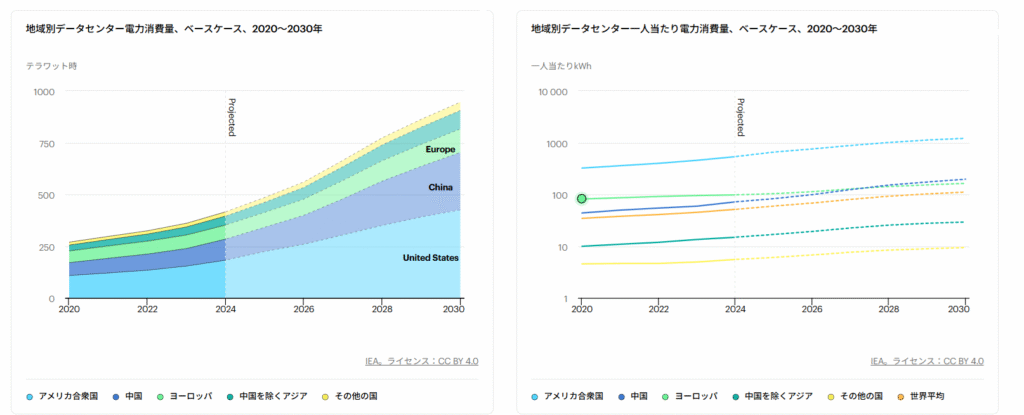

IEA(国際エネルギー機関)

IEAにおいても、世界のデータセンター全体の電力消費は2030年までにほぼ2倍に増加し、AIを動かすためにデータセンターやクラウド上で実行される処理やタスクである、AIワークロード(加速サーバー)が消費増加の主要因となる、と分析しています。その中でも、データセンターの電力消費量の増加が最も顕著な地域は中国と米国で、2030年までの世界全体の増加分の約80%を占めるとの報告をしています。

ITIF(米国技術革新政策センター)

ITIFはイギリスに拠点を置くAccess Partnershipの報告を解説する形で、現在のAIの成長ペースから大量のエネルギーを消費するデータセンターの規模と数の増加が見込まれると報告しています。実際、この需要を満たすには、2030年までにデータセンターの容量を130%増強する必要があり、これはハイパースケールデータセンター1,000棟を建設するのと同等の規模となり、大手テクノロジー企業が既に投資しているインフラ投資(推定3兆ドルから8兆ドル)に加えて、さらに2.8兆ドルの投資が必要になることも伝えています。その反面、データセンターに依存せず、ユーザーデバイス上で動作する軽量モデルであるオンデバイスAIは、このデータセンターのボトルネックに対する解決策となるため、これらの小型AIモデルが広まることは、AIの総消費電力を約90%削減すると推定されているとも添えています。

この他にも、国内外問わず多くの研究機関や企業からAI拡大による、データ処理に関しての見解が発表されています。こうした課題に対して、すでに多くの企業や国が対策フェーズへと移行し始めており、AIの成長を前提としたインフラ整備やエネルギー確保、計算資源の最適化は、もはや将来の構想ではなく「現在進行形の現実」となりつつあります。AIの未来は「限界」ではなく、「どう支えるか」という段階に入ったと言えるでしょう。

では、具体的に企業や国はどのような対策を取っているのでしょうか。

データセンターとは

データセンターは、デジタル世界を支える物理的な施設です。膨大な量のデータを保存、処理、移動することで、クラウドサービスから人工知能まで、あらゆるものを動かしています。このセンターは広大な敷地に作り、且つ寒冷な土地にすることでデータ処理を行う上で発生する熱を逃がすことが可能であると考えられています。

日本のデータセンター事情

日本には少なくとも120〜200以上のデータセンターがあります。用途・規模・運営形態はさまざまでAIの普及とともに、新設・拡張計画も増えているというのが現状です。

◇拠点別 データセンターの特徴

国内データセンターの中心地であり、最大の集中地とされているのが首都圏(東京/千葉・埼玉・神奈川)です。たとえば東京だけで 70〜80拠点以上とされ、東京・千葉・埼玉では大手クラウドや企業向け施設が多数稼働しており、今後も増設される見込みです。

東京に次ぐ第2の拠点として多いのが、関西(大阪・京都・兵庫)で西日本拠点としての重要性があげられています。

そして、冷涼気候を活かした省エネ運用に適する立地として注目をされているのが北海道(石狩・苫小牧など)です。電力・冷却コストの低減に強みがあり、生成AI向けの大規模施設誘致が進んでいます。

また、海底ケーブル接続の利点から、アジア向け通信バックボーンの拠点化が進行中であるのが九州(福岡・北九州ほか)です。国際接続&補完的立地として、現在増加の傾向が見られています。

◇データセンターの種類

・クラウド大手(AWS / Google / Microsoft など)の拠点

・国内通信/IT企業(NTT、KDDI、IDCフロンティアなど)

・企業・研究機関向けの専用施設

・エッジ/マイクロデータセンター(小規模分散型)

◇AI向けデータセンターの数と特徴

AI処理向けサーバー電力総容量は2024年で約67MW、2028年には約212MWまで増える見込み(約3.2倍)であるとIDC JAPANは予測をしています。

「AI向け」と明示された施設数の統計は公表が細かくないものの、全体の増設トレンドに伴ってAI向け部分が急増しているという傾向があります。

AI向け施設の特徴として・・・

① 高電力・高冷却需要

② 省エネ/自然環境活用

③ 地域分散の流れ

というものがあり、災害発生時の影響を分散させたり、膨大な処理量を効率よく処理するために寒冷地を選ぶなど他とは異なる特徴があります。日本のデータセンターは 東京・大阪に集中しつつも、AI処理の急増に対応して 北海道・九州・地方都市への分散が加速しており、AI向け拡張は高電力・高冷却インフラの確保を伴いながら全国へ広がりを見せています。

AI共存社会を支える仕組みとは

ソフトバンク 「次世代社会インフラ」

通信の大手企業であるソフトバンクは、単なるIT投資としてではなく、国や都市レベルでAIを動かし続けることが前提の基盤を、今作ろうとしています。通信 × 計算 × データ × エネルギーを一体で設計する社会インフラを作ることでこれからのAI共存社会を支えていこと動いています。

その中核にあるのは、AIデータセンターの建設です。生成AI・大規模推論を前提にした設計で、GPUを大量に置き、北海道などの地方立地の寒冷地に冷却・電力を最初からセットにする形で設計を行い建設しています。立地に関しては、現在のデータセンターの約8割が東京圏や大阪圏に集中しています。そのため、大規模災害などのリスクや電力負荷の偏りといった課題への対応として、デジタルインフラの全国への分散が求められています。

再生可能エネルギーを100%活用した地産地消型のグリーンデータセンターとして運用される予定であることも公表されており、完成後の運用に注目が集まっています。

Microsoft 「Fairwater AI data center」

2024年から建設中のフェアウォーターAIデータセンターの総投資額は70億ドルを超え、敷地には2つの施設が建設される予定です。完全稼働すれば最大900人の正社員雇用が創出されると予想されています。

また、施設の90%以上は、最先端の閉ループ液冷システムを採用しており、継続的に循環する形をとっています。残りの部分は外気を利用して冷却し、最も暑い日に飲み水に切り替えることで、環境への影響を最小限に抑え、運用効率を最大化する作りとなっています。地球を4周できるほどの光ファイバケーブルを備えたデータセンターでありながら、年間の水使用量は控えめで、一般的なレストランの年間使用量、または夏のピーク時に18ホールのゴルフコースが毎週使用する量とほぼ同じというのが驚きです。

環境に配慮した持続可能な施設として、AI共存の一助となることは間違いないでしょう。

NEXTDC 「TK1 Tokyo」

オーストラリアのデータセンター運営会社NEXTDCは、東京の中心である東京タワーに隣接する形で、AI対応データセンター「TK1 Tokyo」を建設中です。「完成は2030年後半の予定で、安全で低遅延のクラウドサービスへの接続を提供し、AIや自動化、高度なデジタルサービスの導入に寄与するデータセンターとなる」と語っています。

TK1 Tokyo は、企業・クラウド・防衛機関などがAI処理・高性能演算・自動化・デジタルサービスなどを動かすための高密度・高性能ワークロードに対応する設計になっています。AI処理やビッグデータ解析などで高い電力を必要とする用途に必要な、約28メガワット(MW) のIT電力容量を計画しています。

東京の中心にあるという立地から、国内ネットワークへの接続の密度が高く、主要クラウドサービスとの直接接続が行えるという利点を持っています。低遅延でのデータ処理・サービス運用が可能になり、AI推論やリアルタイム処理にとって重要なポイントにもなります。

この施設は単なるサーバールームではなく、ハイパースケーラー(超大規模クラウド)や大企業・官公庁、防衛組織なども利用できる「戦略的デジタルインフラ」として位置づけられています。

スターゲイトプロジェクト

今、注目の新たな動きとしてOpenAIが中心となり今後4年間で総額約5000億ドルをAIインフラに投資し、合計10GW規模のデータセンター群(主に米国)を構築する計画を公式に発表しています。プロジェクト名は「Stargate Project」。このプロジェクトにはOracleやNVIDIA、日本の企業であるソフトバンクも参加しています。

AIインフラの構築に最大5000億ドルを費やすことを計画で、米国内に5つの新たな人工知能データセンターを建設する計画が発表されています。米国の政府(トランプ政権)もこの事業を後押しする姿勢を取っていることから、民間企業主導のAIインフラ計画に政府が協力しているいえます。

さらにUAEでの「Stargate」AIキャンパス構想として、OpenAI・Oracle・NVIDIA・Cisco・G42などが1GW級クラスターを整備する計画も公表されており、「米国中心だが国際展開も始まった」という段階まできていることから、世界的にみてもとても大きなインフラのプロジェックとと言えるでしょう。

また、このプロジェクトが進むことで、これまでマイクロソフトのクラウドサービス「Azure*」がOpenAI向けインフラを事実上独占していた状態から、StargateによりOpenAIが他社のクラウド基盤も併用できるようになり、インフラがマイクロソフト一社に固定されない構造へと変わることになります。

(*Azure(アジュール)とは、マイクロソフトが提供するクラウドサービスで、企業や政府機関がインターネット経由で、サーバーやAI、データ処理基盤を利用できる仕組みであり、頭脳というよりも工場や発電所に近いAIやサービスを動かすための見えない社会インフラ)

スターゲートは、「AIが重くなりすぎて既存インフラでは足りない」という問題に真正面から向き合う対策となります。このプロジェクトでAIを単なるソフトウェアではなく、電力・土地・国家戦略を含む「社会インフラ」として再定義する試みでもあり、これによりAIの計算規模は飛躍的に拡大すると考えられます。しかし、その一方でAIを動かせる国と企業の集中が進むという新たな課題も浮かび上がると予測され、国家単位で対策や仕組み作りが必要になることは間違いないでしょう。

まとめ

AIのエネルギー問題は、遠い未来の話ではありません。すでに世界各地で、AIを動かすための電力とインフラの再設計が始まっています。問われているのは「AIを止めるか、進めるか」ではなく、どんな社会の上にAIを走らせるのかという選択です。その選択は、技術者だけでなく、企業や国家、そして私たち一人ひとりのAIへの向き合い方に委ねられているのではないでしょうか。

コメント