子どもがスマートフォンを持つことは、いまや珍しいことではなくSNSがきっかけとなった子どもの犯罪被害が年々報告されています。こうした状況の中で近年注目されているのが、AIを使った「子どものネット見守り技術」です。

この記事では、子供を様々なリスクから守るためのAI技術についてご紹介します。

子どものスマホは「危険と隣り合わせ」

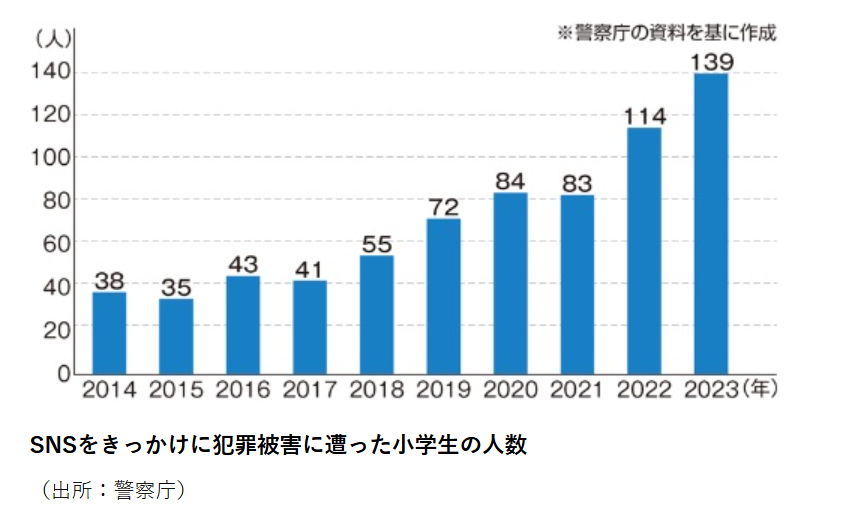

警察庁の統計によると、2024年にSNSを通じて犯罪被害にあった18歳未満の子どもは1,486人にのぼります。被害はInstagramやXなど一般的なSNSで発生しており、児童ポルノや性的犯罪が多くを占めています。また、小学生の被害は2015年の35人から約4倍に増加しており、低年齢化も進んでおり、約7割のケースでは子ども自身のSNS投稿が犯罪者との接触のきっかけとなっていたことがわかっています。

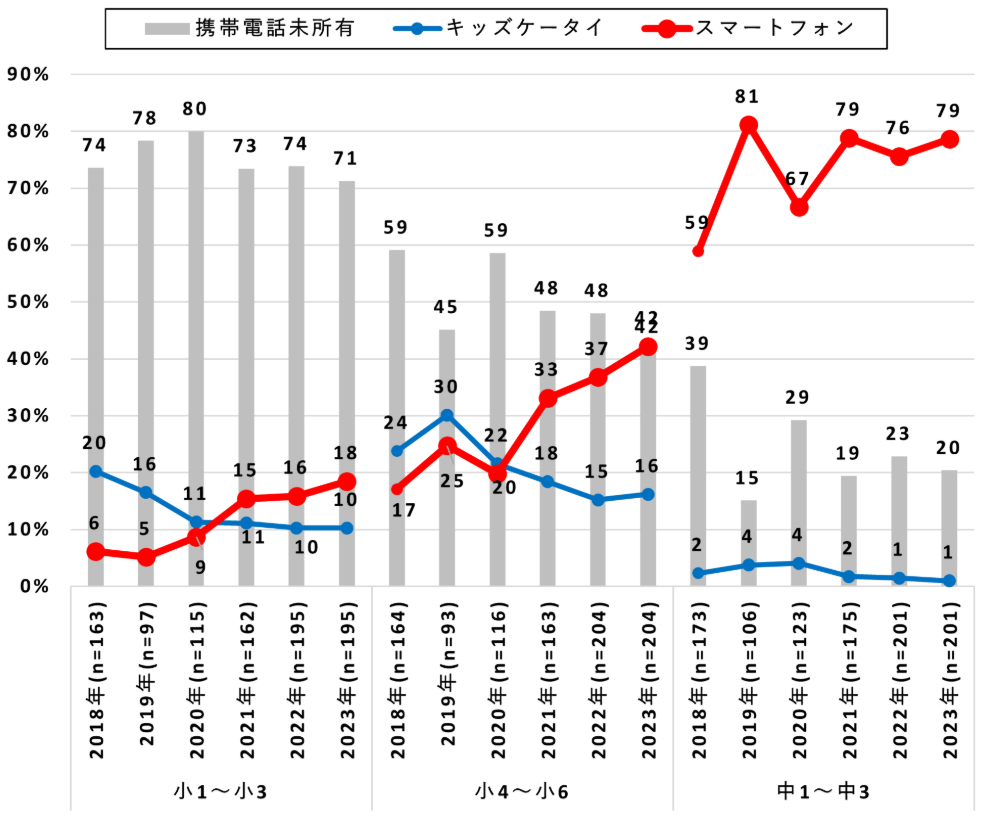

動画視聴、ゲーム、SNS、オンライン学習――スマートフォンは子どもにとって、学びやコミュニケーションの重要なツールになっています。しかしそんなスマートフォンによるネットの利用には便利であると同時に、多くのリスクも存在します。モバイル社会研究所の2023年11月に実施した調査より、小中学生が自分専用のスマホ・キッズケータイを所有している状況であることがわかりました。特に小学生高学年では初めて4割を超えています。

また、日本の警察庁によるとSNSがきっかけとなった子どもの犯罪被害は年々報告されており、未成年がオンラインで見知らぬ相手と接触するケースも増えています。ネットいじめ、性的搾取、詐欺など、子どもが巻き込まれるトラブルの種類は多様化しています。

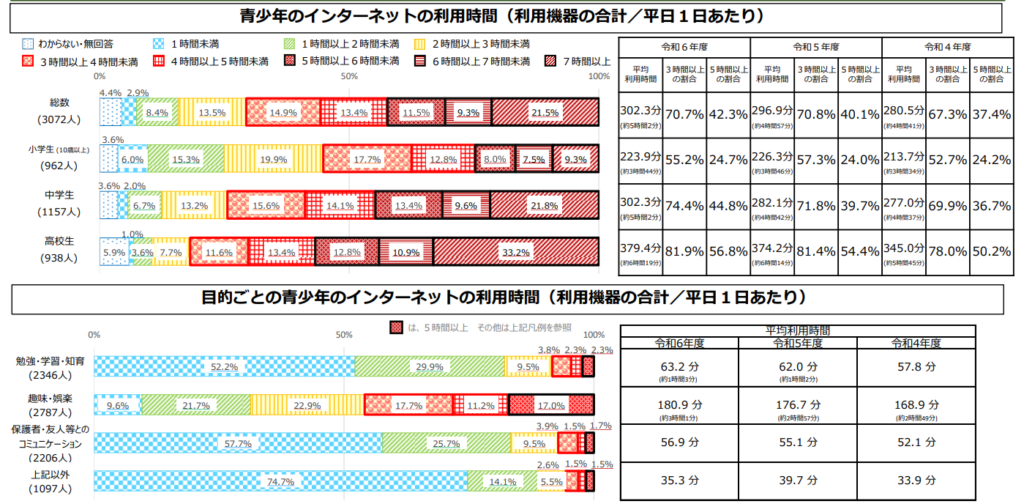

さらに、SNSや動画サービスのアルゴリズムは非常に強力で、子どもが長時間利用してしまう「スマホ依存」も問題になっています。こうした状況の中で注目されているのが、AIを使った「子どものネット見守り技術」です。

AIは膨大なデータを解析し、人間だけでは気づきにくい危険を検知することができます。いま世界では、子どものネット安全を守るためにAIを活用する取り組みが急速に広がっています。

AIはどのように子どもを守るのか

子どものスマホを守るAIは、主に3つの技術で構成されています。

1⃣画像認識AI

ディープラーニング(深層学習)を用いて画像や動画の内容(物体、顔、文字、異常など)を高速・高精度に解析・識別・分類する技術。顔認証、工場の外観検査、自動運転、医療画像診断など多岐にわたる分野で活用され、自動化や生産性向上にも貢献。

⇒この技術を活用して、AIが画像や動画を解析し、ポルノや暴力などの不適切コンテンツを検知

2⃣行動分析AI

人間や動物の行動を自動的に検知・データ化・する技術。個人の健康管理や、ショッピングセンター、スポーツ・製造業やセキュリティなど、幅広い分野で応用されている。

⇒この技術を活用して、SNSのやり取りや関係性を分析し、ネットいじめや犯罪の兆候を検知

3⃣利用パターン分析AI

機械学習やAI技術を用いて、ユーザー、顧客、またはシステム(機械・機器)の動作・操作データ(ログデータ)を解析し、行動パターンや傾向を自動的に特定・予測する技術。

⇒この技術を活用して、スマホの利用時間やアプリ使用状況を分析し、依存や危険な利用傾向を把握

従来のフィルタリングは「特定のサイトをブロックする」仕組みが中心でしたが、AIはコンテンツや行動そのものを分析できるため、より高度な安全対策が可能になっています。

AI見守りサービスの実例

◇Canopy

Canopyは、イスラエルの技術系チームによって開発され、倫理的なインターネット利用を促進する運動の一環として展開された。米国を中心に利用が拡大しており、同種の製品(Qustodio、Bark など)と並ぶ主要な保護アプリの一つとされています。

このアプリはAIによる画像解析を利用し、スマートフォンに表示される画像や動画をリアルタイムで分析します。もしポルノ画像や性的コンテンツが検出されると、画面を自動的にぼかしたり、コンテンツをブロックしたりします。特徴的なのは、ページ全体ではなく画像単位で判定できる点です。

例えば、通常のフィルタリングではブロックされないSNSや掲示板でも、AIが不適切画像を検知すれば表示を制限できます。さらに、セクスティング(性的メッセージのやり取り)や危険なSNS利用の兆候を警告する機能もあり、子どものネット利用をリアルタイムで見守ることができます。

◇Filii

Filii(フィリー)は、ソースネクスト株式会社が開発したサービスです。子どものスマートフォンにインストールしたアプリやSNS投稿をAIが解析し、不適切な表現や危険なやりとりを検知して保護者に通知します。このサービスの特徴は、SNSの「人間関係」を分析する点にあります。

AIがスマートフォンの利用状況を解析し、急にやり取りが増えた相手・見知らぬアカウントとの頻繁な接触・不自然なコミュニケーションなどを検知します。分析対象はLINEやTwitterなど主要SNSに対応し、リスクワードやストレス兆候を抽出する。これにより保護者は子どものネット上でのストレスや危険傾向を早期に把握できます。

教育機関や自治体での導入事例もあり、ネットリテラシー教育の一環として評価されています。保護者にとっては、スマホ利用を全面的に制限せず、子どもの自主性を尊重しながら安全を確保できるツールとして注目されています。

◇i‑フィルター

デジタルアーツ株式会社が提供する有害サイトフィルタリングソフトウェアで、家庭や企業、学校などでインターネット利用を安全に保つため、閲覧制限や情報漏洩防止を行う。教育機関・家庭向けではPTA推薦製品として広く普及しています。

「i-フィルター」は、青少年の健全育成と企業の情報セキュリティ確保を両立させるツールとして位置付けられており、全国の教育委員会の約半数が導入し、インターネットリテラシー教育の基盤ソフトとしても利用されています。2025年以降もマルチデバイス対応版など継続提供が行われています。

SNS企業もAIで未成年を保護

子どもたちがスマートフォンを持つようになると、自然とインターネットに触れる機会も大きく増えていきます。その分だけ便利さが広がる一方で、トラブルや危険に近づきやすくなるという側面もあります。主なインターネット利用におけるリスクは不適切なコンテンツへの接触・詐欺や個人情報の流出・依存傾向などです。これらのリスクは主にSNSを通じで発生します。

世界的にSNSを通じた青少年の犯罪被害などが問題視されたことで、SNS企業も対策を講じるようになってきました。例えば TikTok や Instagram では、AIがユーザーの年齢を推定し、未成年アカウントに対して安全設定を自動的に強化する仕組みが導入されています。

児童性的搾取を防ぐために世界中の企業がAIを活用しています。その中心的な団体が National Center for Missing & Exploited Children です。この団体はAIを使って児童性的虐待画像(CSAM)を検出する技術を運用しており、IT企業から報告された違法コンテンツを分析しています。現在では、世界中のプラットフォームがこうした技術を利用して違法画像の拡散を防いでいます。

AI研究の最前線とこれからの課題

研究分野でも、子どものネット安全を守るためのAIが開発されています。例えば、音声AIアシスタント向けのアプリを解析し、子どもから個人情報を聞き出す危険なアプリを検出するAIなどが研究がされています。

研究者は数千のアプリを分析し、個人情報の不正取得・不適切な会話・子どもを誤解させるアプリ設計といった問題を発見しました。このように、AIは「危険なコンテンツ」だけでなく、「危険な設計」そのものを見つける技術へと進化しています。

ただし、AIが万能というわけではありません。AIによる見守りにはいくつかの課題もあります。子どものプライバシーの問題・過度な監視への懸念・AIの誤検知などです。AIがすべてを自動で判断する社会は決して望ましいものではなく、人の役割を弱めてしまう危うさもあります。大切なのは、AIを子どもを“監視する装置”として扱うのではなく、親や教育者がより良い判断を下すための補助的なツールとして位置づけることです。AIは危険の兆候を知らせたり、情報を整理したりする力を持っていますが、子どもの状況を理解し、価値観や倫理観を踏まえて最終的に判断するのはあくまで人であるべきです。

まとめ

スマートフォンは、子どもにとって大きな可能性を持つ道具です。世界中の情報に触れ、学び、友人とつながることができます。しかし同時に危険も存在するため、AIはその見えにくい危険を可視化し、早期に発見する技術として発展しています。スマホ時代の子育てにおいて、AIは親にとって子どもを守るための新しいパートナーとして、これからますます重要な役割を担っていくことになるでしょう。

コメント